对于近日引发社会关注的“AI盗播带货”行为,本文作者从版权角度提出,“AI盗播带货”侵犯著作权和表演者权,对其治理,需构建司法、监管、行业协同的全链条机制,明确平台责任与防范机制,完善罚则,增强威慑——

近日,演员温峥嵘遭遇直播间 AI仿冒的事件引发社会广泛关注。笔者认为,从版权角度,“AI盗播带货”行为主要涉及对两类版权客体的侵犯:一是直接侵犯原始视频或直播内容中的作品权利,二是侵犯表演者享有的邻接权。从作品类型看,被盗播的内容可能构成多种著作权客体。直播活动中,如果主播的讲解、评述具有独创性,可被认定为口述作品;而经过精心编排、具有独创性镜头切换和画面选择的直播整体,也可能构成视听作品。即使直播内容未能构成作品,其固定化的连续影像也可能作为录像制品受到邻接权保护。

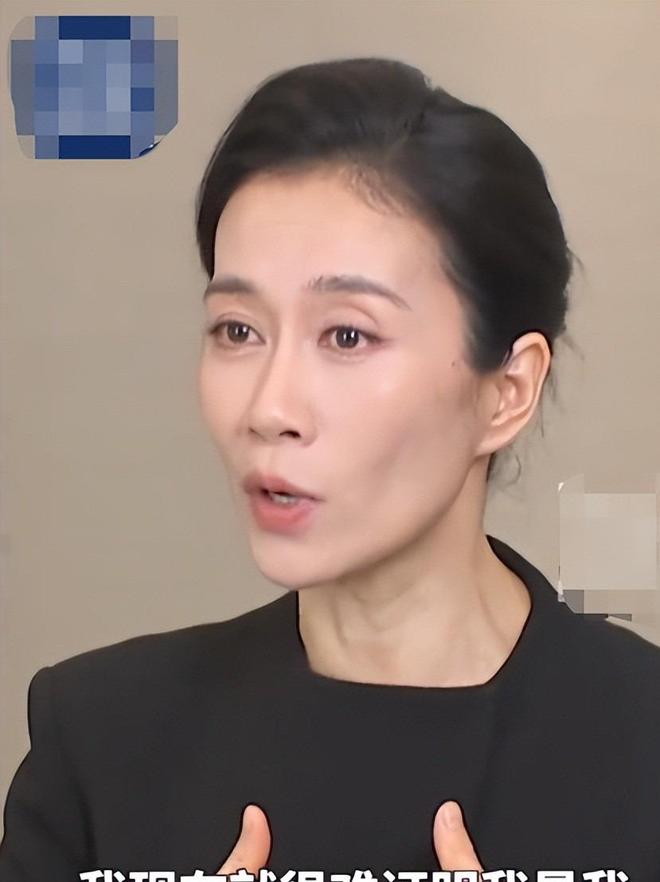

AI“温峥嵘”直播带货

构建多维度治理体系

我国著作权法第十条规定,著作权人对其作品享有保护作品完整权、复制权、信息网络传播权等核心权利。“AI盗播带货”场景中以下行为构成侵权:在剪辑、拼贴名人视频或直播片段情形下,若商家未经授权将名人的表演视频,如直播片段、讲解视频进行剪辑、拼贴,属于“数字化复制”行为;若将上述内容上传至电商平台等供用户浏览,则进一步侵犯信息网络传播权;若商家通过 AI技术将拼贴内容包装为“名人本人推荐”,则是对原作品的歪曲使用,侵犯著作权人的保护作品完整权。

对表演者而言,著作权法第三十九条专门规定了表演者权,明确表演者对其表演享有表明表演者身份、保护表演形象不受歪曲等权利。如商家未经授权使用名人姓名或艺名、变体昵称,或直接使用名人头像却不标明表演者身份,甚至虚假宣称“本人推荐”,则违反著作权法第三十九条第一项,表演者有权要求他人在使用其表演时表明身份,商家的行为剥夺了表演者对其表演的“表明身份权”。

“AI盗播带货”对行业危害极大,亟待治理。笔者认为,需构建司法、监管、行业协同的全链条机制,具体路径如下:

在发展司法标准方面,明确 AI场景下的权利边界。第一,细化 AI生成内容的侵权认定标准。现行著作权法未明确 AI生成内容的“模仿行为”是否构成侵权,建议通过司法解释明确,若 AI生成内容实质性模仿他人的表演形象、风格或作品核心要素,且用于商业目的,应认定为侵权。第二,扩大表演者权的保护范围。针对AI技术对“虚拟表演形象”的仿冒,建议在司法解释中明确,以 AI技术仿冒表演者虚拟形象进行商业活动的,构成侵犯表演者权。

在强化行政监管方面,强化全流程执法。首先,应强化源头监管。市场监管部门应加强对“AI生成内容工具”的监管,要求 AI工具提供者在用户生成的涉及人物形象的内容中显著强制嵌入“非真人原声”标识;对提供“AI名人仿冒服务”的商家,依法处以“停止违法行为+罚款”的处罚。其次,注重过程监管。网信部门应要求平台对“AI生成内容”进行前置审查,对未标识“AI生成”的内容不予发布;对“仿名人带货”内容,要求平台主动核查“是否取得表演者授权”,未取得授权的立即删除。最后,重视结果监管。版权行政管理部门应建立“AI侵权举报平台”,接受被仿冒者、消费者的举报,对查实的侵权行为,依法责令商家停止侵权、赔偿损失,并将其纳入“知识产权失信名单”并向平台通报,并要求不定期向平台用户公开。

在督促行业自律方面,推动平台与商家的规范经营。一是督促平台自律。电商平台应制定《AI内容使用规范》,明确“禁止使用 AI技术仿冒名人表演形象”“禁止虚假宣称名人推荐”等条款;对违反规范的商家,采取“下架商品+封店”的处罚措施。二是引导商家自律。行业协会应推动商家签署《AI内容使用承诺书》,承诺“不使用 AI技术侵犯他人著作权或表演者权”;对违背承诺的商家,给予“不诚信商家”标识,促进良性竞争。

温峥嵘问:“你是温峥嵘?那我是谁?”

温峥嵘问:“你是温峥嵘?那我是谁?” 平台应完善防范机制

治理“AI盗播带货”,网络平台扮演着重要的角色。根据民法典第一千一百九十五条(网络侵权的“通知-删除”义务)、电子商务法第四十二条(电商平台的“通知-删除”义务)、第四十五条(平台的“连带责任”),平台在“AI盗播带货”中需承担以下责任:

在平台的法定义务方面,平台接到权利人的侵权通知后,应及时采取删除、屏蔽、断开链接等措施;若未及时采取措施,对损害的扩大部分与侵权商家承担连带责任。针对“AI生成内容”,平台应承担主动审查义务,通过 AI检测技术识别“仿名人形象”“未标识 AI内容”的商品链接,要求附授权材料审核,否则应予删除;若明知商家从事“AI盗播带货”而不采取措施,可能与商家承担共同侵权责任。平台应向权利人披露侵权商家的真实身份信息,协助权利人维权。

在平台的防范机制构建方面,平台应强化技术与制度治理。一是技术防控。引入“AI内容检测系统”,通过对比名人的声音、形象特征等“特征匹配”识别“仿名人 AI内容”;对平台内的视频内容添加“版权水印”,确保原作品的可追溯性。二是制度防控。建立“商家资质审核机制”,使用AI仿人声人像内容,商家应上传“AI内容使用授权书”;设立“侵权投诉绿色通道”,为权利人提供“一键投诉”功能,缩短投诉处理时间。三是惩戒机制。平台应建立商家知识产权信用档案,对重复或恶意侵权者,在依据规则下架宣传视频、处罚店铺的同时,将其列入重点监管名单并加强抽查,更重要的是,将其信用状况与流量扶持等权益直接挂钩,树立“守信受益、失信难行”的明确导向。

完善罚则增强威慑

《人工智能生成合成内容标识办法》(下称《标识办法》)和2025年9月1日起施行的配套强制性国家标准《网络安全技术 人工智能生成合成内容标识方法》构成的规范体系,要求所有 AI生成的文字、图片、视频等内容都要“亮明身份”,但实践中存在一些难点。

当前《标识办法》面临执行挑战,主要原因在于其法律责任条款的弱化。办法虽规定了标识义务,但并未配套明确、有力的罚则,对于违反规定恶意删除、篡改或伪造标识的行为,缺乏清晰的行政处罚标准和量刑依据。根据《标识办法》第十三条的规定:“违反本办法规定的,由网信、电信、公安和广播电视等有关主管部门依据职责,按照有关法律、行政法规、部门规章的规定予以处理。”这意味着《标识办法》本身并未直接设定全新的、独立的罚则。这导致违规成本极低,难以形成有效震慑。同时,办法对生成者、传播平台、使用者等不同主体的责任划分仍不够清晰,对中小企业合规能力考量不足,使得监管链条存在薄弱环节,积极性无法调动。此外,不同 AI系统生成的标识技术标准不统一,也增加了平台识别与验证的难度和成本。

针对上述问题,笔者认为,可从以下三个方面着手改进:第一,健全法律责任体系。亟需在后续实施细则或相关法律修订中,明确设定针对未标识、恶意去除标识等违规行为的具体罚则,包括罚款、停业整顿等阶梯式处罚措施,并与有关的上位法紧密衔接,在合法的范围内大幅提高违法成本。第二,细化监管与执行标准。监管部门需推动建立更统一、互认的标识技术标准,以降低平台合规难度。同时,应明确并压实内容传播平台的管理责任,要求其建立有效的标识核验和违规内容处置机制。第三,强化技术保障与溯源能力。鼓励并投资研发防篡改的数字水印和隐式标识技术,确保标识在内容被编辑后依然可追溯。